Киберпреступники придумали новый способ выводить деньги с украденных банковских карт, привязанных к системам вроде Apple Pay и Google Pay. Вектор, получивший название Ghost Tap, передаёт NFC-данные карт «денежным мулам» по всему миру.

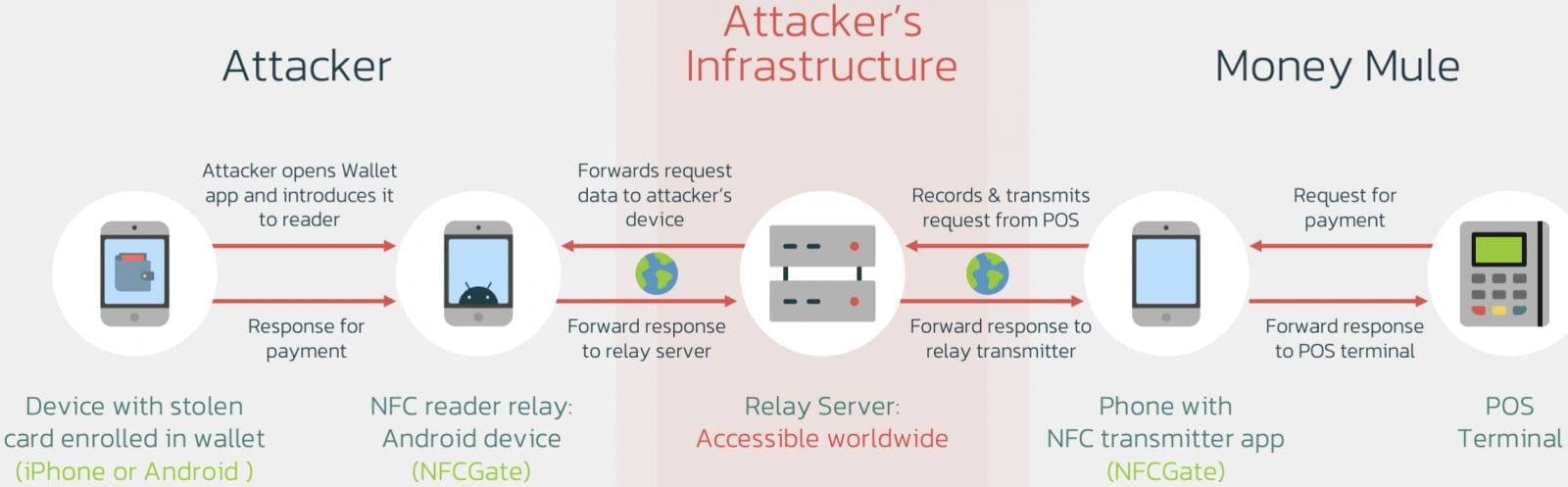

Ghost Tap берёт за основу другой метод, о котором мы рассказывали в августе: Android-вредонос NGate задействовал компонент с открытым исходным кодом — «NFCGate».

Тем не менее Ghost Tap использует более мощную обфускацию и, соответственно, его сложнее детектировать. В этом случае злоумышленнику не нужна карта или устройство жертвы.

Вместо этого Ghost Tap подключает «денежных мулов» в различных удалённых местоположениях. Такие «мулы» должны взаимодействовать с PoS-терминалами.

О новом векторе рассказали специалисты компании Threat Fabric. По их данным, в последнее время наблюдается скачок в использовании этой техники в реальных кибератаках.

А вот так выглядит поиск «денежных мулов» на одном из киберпреступных форумов:

Для начала атакующему нужно выкрасть данные банковской карты и перехватить одноразовый пароль, который нужен для регистрации виртуального кошелька в Apple Pay и Google Pay.

Для первого пункта можно использовать, например, банковский троян, накладывающий фейковые окна поверх легитимных приложений, или тот же кейлогер. А одноразовый код можно получить с помощью социальной инженерии или того же вредоноса, мониторящего СМС-сообщения.

Атакующие по-прежнему полагаются на инструмент NFCGate, который используется для передачи информации платёжных карт. Только в этом случае подключается также сервер-ретранслятор, который отправляет данные в сеть «денежных мулов».