Microsoft тестирует долгожданное изменение в Windows 11: система больше не будет принудительно устанавливать ожидающие обновления, если пользователь выбрал обычное «Завершение работы» или «Перезагрузку».

Раньше всё работало не так очевидно. Даже если нажать «Завершение работы» или «Перезагрузка», Windows могла начать установку важных обновлений, особенно если они уже какое-то время ожидали перезагрузки.

Это раздражало пользователей, которым нужно было быстро выключить ноутбук, перезагрузить десктоп или уехать, не дожидаясь завершения установки.

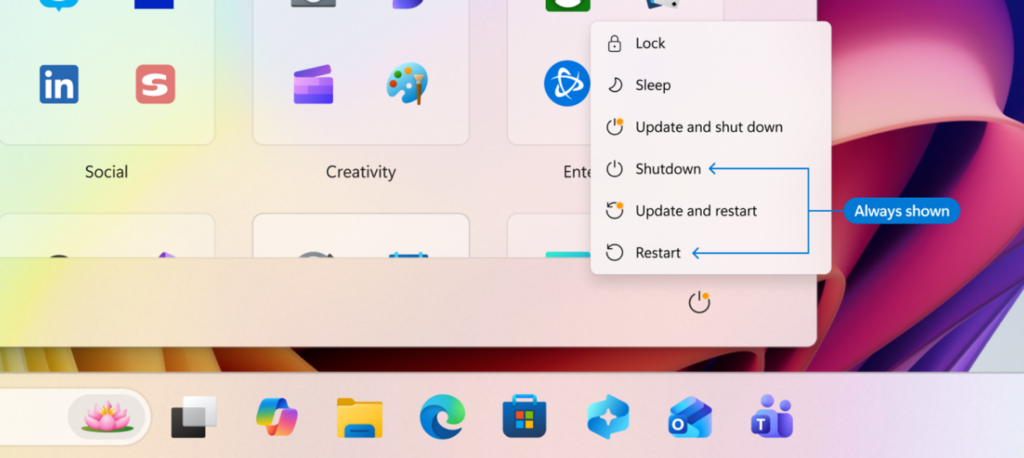

Теперь варианты в меню будут более адекватно разделены:

- «Завершение работы»;

- «Перезагрузка»;

- «Обновить и завершить работу»;

- «Обновить и перезагрузить».

Главное отличие в том, что первые два пункта теперь должны работать без установки обновлений.

По словам Microsoft, у разработчиков стояла задача сделать процесс более предсказуемым. Если человеку нужен быстрый перезапуск или выключение перед поездкой, система должна выполнить именно это действие.

Пока новшество тестируется в сборке Windows 11 Build 26300.8289 и доступно только участникам программы Windows Insider. Когда функция появится у всех пользователей, пока неизвестно.

При этом Microsoft уже исправила похожую проблему с кнопкой «Обновить и завершить работу». Раньше Windows могла после установки обновлений не выключить компьютер, а перезагрузить его. Исправление этой ошибки вышло в октябре 2025 года.

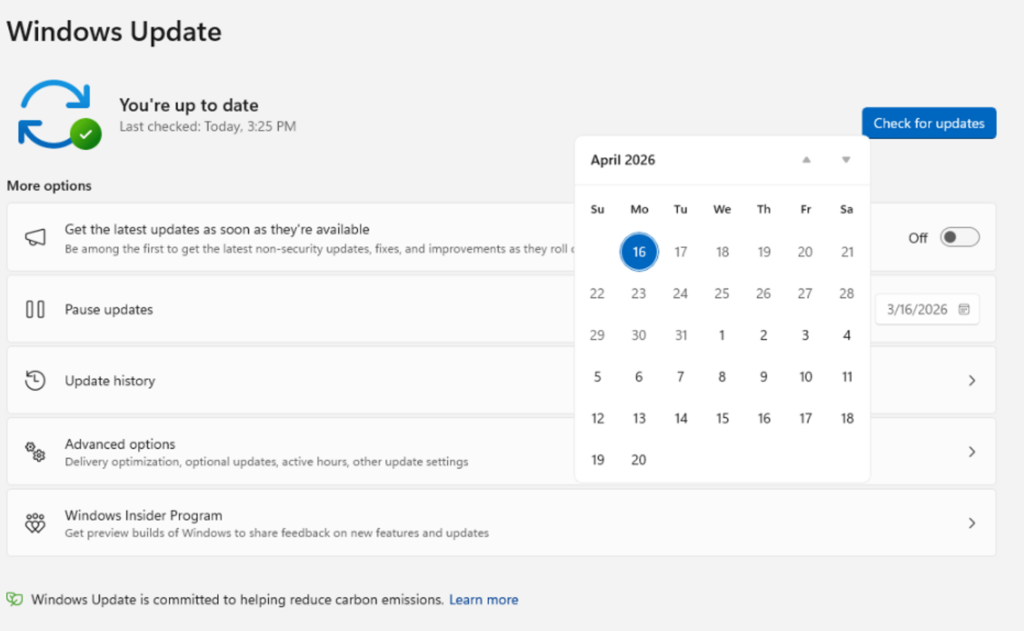

Кроме того, компания работает над более гибким управлением обновлениями. В тестовых версиях Windows 11 появилась возможность ставить обновления на паузу до 35 дней и выбирать дату в календаре.