Исследователи из сообщества DomainTools Investigations (DTI) выявили десяток новых доменов .TOP, используемых для распространения Android-трояна SpyNote. Находки имитируют страницы Google Play Store для скачивания различных приложений.

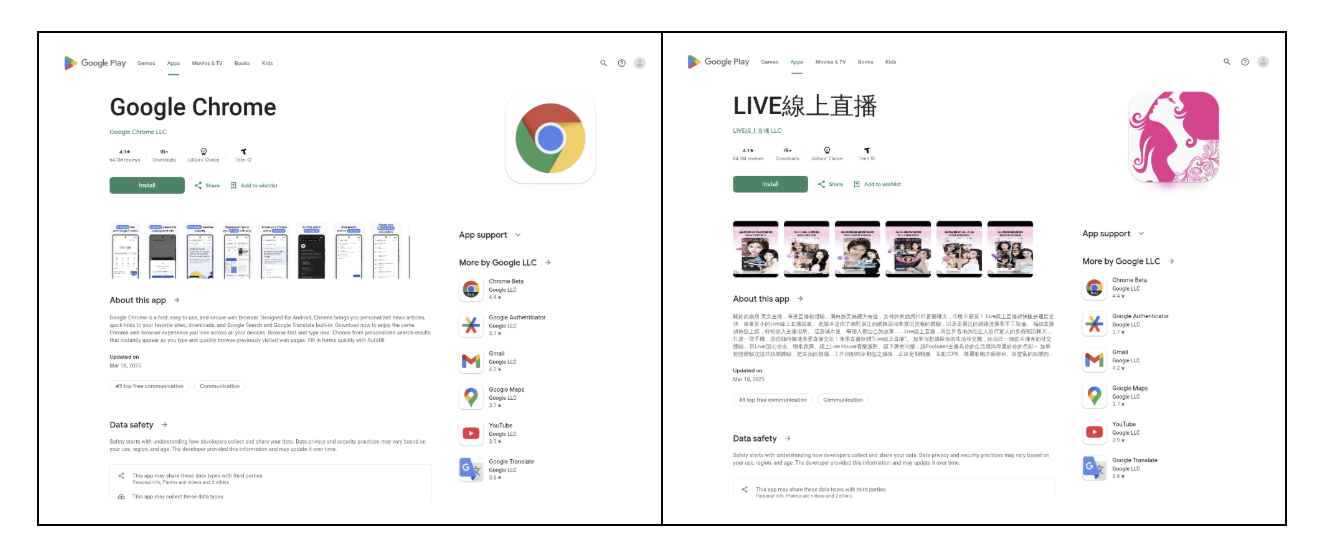

Фальшивки оформлены на английском либо китайском языке. В кодах сайтов и самого зловреда обнаружены синоязычные комментарии.

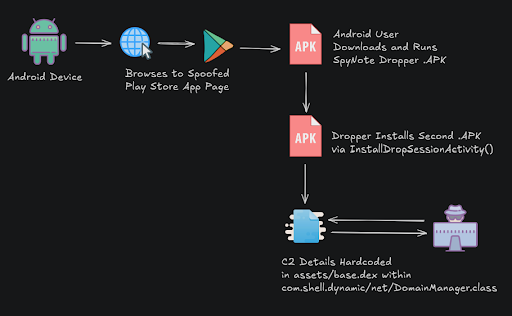

Поддельные страницы содержат карусель изображений, которые при клике загружают на устройство визитера APK — дроппер, сбрасывающий SpyNote.

При установке вредонос запрашивает множество разрешений, которые нужны ему для кражи данных (геолокации, контактов, журнала звонков, СМС, файлов), включения камеры и микрофона, манипуляции вызовами и выполнения команд.

В мае прошлого года SpyNote раздавался под видом антивируса с поддельного сайта Avast.

Маскировка мобильного зловреда под легитимное приложение — обычная практика в мире киберкриминала. Распространители шпионов BadBazaar и Moonshine, например, за последние два года создали более 100 троянизированных клонов популярных Android-приложений.