GenAI совершает ошибки аналогично человеку. Часть из них даже называют «галлюцинациями». Преимущества в скорости, конечно, неоспоримы, но можно ли поручать GenAI ответственные решения? Ведь он не понимает смысла, у него нет моральных ограничений. Да и юридическую ответственность на него не возложишь.

- Введение

- Как GenAI используется в обороне: проект Scale AI Thunderforge

- Можно ли доверять GenAI: иллюзия надежности или реальный инструмент

- Основные риски применения LLM в принятии решений

- Галлюцинации GenAI: как проверяется достоверность данных LLM

- Почему LLM ошибаются: ключевые причины снижения точности GenAI

- Будущее GenAI: какие шаги нужны для повышения надежности

- Как обеспечить достоверность и безопасность при работе с LLM

- Выводы

Введение

Два года назад, в марте 2023 года, более тысячи человек, включая мировых знаменитостей, таких как Стив Возняк и Илон Маск, поставили первые подписи под письмом, подготовленным от имени организации The Future of Life Institute. В нем содержался призыв ко всем лабораториям, занимающимся разработкой ИИ-систем: немедленно приостановить как минимум на шесть месяцев обучение систем, превосходящих GPT-4 по мощности.

Причин для подачи этой инициативы было много. Одна из них — угрозы, связанные с этическими проблемами, возникающими во взаимоотношениях людей и генеративного ИИ (GenAI) и еще не осознанных до конца по части последствий. Не было также оценки рисков и способов контроля безопасности при использовании ИИ.

Прошло два года. На данный момент число подписавших превышает 33 тыс. человек и продолжает расти. Но кажется, что мало что изменилось. Так ли на самом деле?

Рисунок 1. Письмо The Future of Life Institute с призывом «притормозить» ИИ

Как GenAI используется в обороне: проект Scale AI Thunderforge

Рассказ о произошедших изменениях начнем с оборонных технологий. Как бы кто ни относился к этой теме, их влияние на экономику растет и имеет долгосрочный тренд на ближайшие годы.

Увы, открытой информации о развитии российских систем в этой области практически нет, поэтому рассмотрим то, что происходит за океаном. А там в марте 2025 года произошли важные события.

Как стало известно, подразделение оборонных инноваций МО США (Defense Innovation Unit, DIU) объявило о заключении контракта на разработку «флагманской программы» по использованию ИИ-агентов для планирования и проведения войсковых операций. Инициатива, получившая название Thunderforge, призвана обеспечить внедрение ИИ для решения задач штабного планирования и управления на театрах военных действий (ТВД). Конечной целью проекта должно стать создание автоматизированной системы принятия решений, которая будет работать на базе распределенных ИИ-агентов. Система будет работать в автоматическом режиме, хотя внешний контроль со стороны человека сохранится. Создание этой ИИ-системы позволит значительно ускорить обработку больших объемов оперативной информации, генерировать сценарии развития событий на ТВД, принимать автономные решения на поле боя с оценкой текущей ситуации и быстрого реагирования на угрозы.

Головным подрядчиком проекта Thunderforge стала компания Scale AI. Она известна своим опытом по сбору данных для обучения больших языковых моделей (LLM) для таких заказчиков, как OpenAI, Google, Microsoft и Meta (запрещенная в России как экстремистская организация). Экосистема Thunderforge будет включать в себя также Open Source платформу двойного назначения Lattice от компании Anduril, которая будет отвечать за интеграцию собираемой с датчиков информации и выполнение команд, генерируемых ИИ. При автоматизированном принятии решений будут использоваться LLM-модели, поддерживаемые Microsoft.

Теперь о планах. Уже сейчас запланированы штабные игры и учения на базе создаваемой системы в местах ее первых инсталляций. Система Thunderforge должна появиться в штабах в Индо-Тихоокеанском регионе (INDOPACOM) и Европе (EUCOM).

Этим внедрением США претендуют на роль первой страны в мире, где принятие решений в такой ответственной сфере, как армия, будет передано под управление ИИ. Этот шаг может стать определяющим для дальнейшего развития.

Вспомним о письме The Future of Life Institute, под которым продолжают постоянно появляться новые подписи. Решение о моральной допустимости принятия ответственных решений силами ИИ уже принято, несмотря на такие инициативы? Новые ИИ-системы настолько надежны, что риски, связанные с их эксплуатацией, исключены? Как эти системы будут контролироваться с точки зрения их собственной безопасности и тех решений, которые будут приниматься ими автономно?

Можно ли доверять GenAI: иллюзия надежности или реальный инструмент

Поклонники ИИ могут опровергнуть страхи пользователей, предложив им привести примеры, препятствующие использованию GenAI наравне с человеком. Ведь человек тоже принимает решения не по «собственной прихоти», а опираясь на набор четких требований, например, законодательной системы. Это — вполне формализованный набор правил, которые ИИ также «умеет понимать». Более того, история показывает, что неукоснительное и точное соблюдение регуляторных правил всегда идет на пользу, а не во вред. С этой точки зрения, применение GenAI должно, наоборот, снижать количество ошибок и принятия необоснованных решений.

Считается, что человек принимает решения, учитывая множество дополнительных, в том числе невербальных факторов — например, мораль. Но что мешает формализовать эти признаки и учесть необходимые, отражающие моральные устои общества в GenAI-модели? Как показывают результаты работы ИИ в генерации контента, они отличаются высоким подобием естественному и способны «передавать» даже чувства. Теперь нужно добиться лишь правильного выбора «технических признаков», чтобы передать управление в руки ИИ.

Отметим, что бизнес относится сейчас с большим воодушевлением к развитию GenAI. Согласно мировой статистике, 88% организаций внимательно следят за его развитием. Тем не менее, опасения по поводу безопасности данных, соответствия нормативным и регуляторным требованиям, точности, этики, риска появления непреднамеренных последствий, способных затормозить внедрение GenAI, сохраняются. Их результатом стало появление набора стратегических принципов, которых должен придерживаться GenAI, чтобы принести реальную пользу:

- Управление ИИ должно осуществляться при сохранении ответственности за принимаемые решения.

- Необходимо обеспечить строгий учет регуляторных требований.

- Требуется соблюдать прозрачность при принятии решений.

Кажется, что все хорошо. Все задачи определены. Но как эти принципы станут реальностью? Что уже сделано для этого?

Основные риски применения LLM в принятии решений

Одна из наиболее серьезных проблем, с которыми может столкнуться компания при использовании GenAI — это принятие им ошибочных решений. Автоматизация только ускоряет процесс, снижает контроль за правильностью промежуточных решений. Есть риск не только появления таких ошибок, но и роста их частоты по сравнению с текущим уровнем.

Если подобные сценарии станут причиной катастрофических последствий, то в результате будет потеряно доверие к инструментам ИИ. Поэтому уже сейчас при внедрении компании вынуждены изыскивать тратить время на проверку данных, получаемых от GenAI, и на исправление ошибок. На фоне роста производительности за счет ИИ компания получает удлинение технологической цепочки. Затраты, потраченные на проверку работы LLM, могут привести к утрате преимуществ, полученных за счет ИИ.

Есть риски также с безопасностью. Обучение LLM-систем проходит на внутренних данных. В случае передачи управления в руки ИИ может возникнуть непреднамеренная утечка, в результате которой могут быть раскрыты данные из внутренней электронной корреспонденции, а также другая конфиденциальная информация. Подобное уже случалось.

Что же получается? Внедрение ИИ влечет снижение доверия к принимаемым решениям по сравнению с человеком? Создаются новые технические уязвимости, повышаются риски ущерба с репутационными последствиями?

Галлюцинации GenAI: как проверяется достоверность данных LLM

Секрета относительно проблемы, связанной с достоверностью результатов работы ИИ, нет. Ее устранение «завернуто» в направление работ по созданию новых методик для обучения LLM. Их цель — это выстраивание процесса обучения так, чтобы была возможность выделять ответы, не подкрепленные доказательствами. Их порождение даже получило новое название — «галлюцинации».

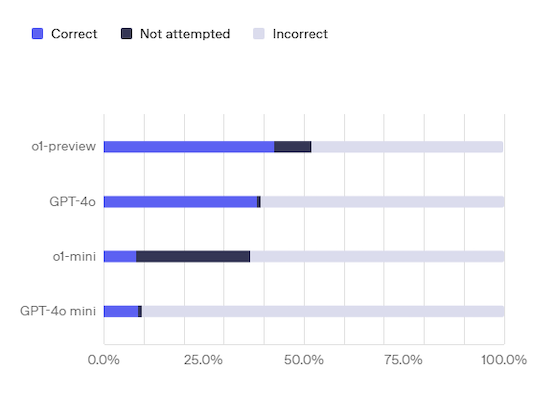

Отражением того, что отрасль уже борется с этим явлением, стал запуск в октябре 2024 года бенчмарка SimpleQA. По данным его вендора, компании OpenAI, этот инструмент позволит иметь рейтинговые оценки, учитывающие уровень достоверности работы разных LLM.

Объективная оценка достоверности — это непростая тема, особенно применительно к ИИ. Можно подобрать команду экспертов и оценить достоверность любого утверждения, которое делает ИИ. Но как сделать подобное, когда ИИ способно порождать бесконечное количество таких «смысловых» утверждений? Требуется учитывать, что языковые модели способны генерировать утверждения, содержащие десятки элементов, каждый из которых требует отдельной проверки на корректность.

В настоящий момент концепция SimpleQA ограничена тем, что выполняются проверки только для коротких запросов. Причина такого решения — они поддаются обработке при разумных затратах времени. Каждому ответу выставляется набор оценок. Они отражают:

- уровень корректности;

- разнообразие охваченных тем;

- достоверность в пограничных областях знаний;

- легкость восприятия человеком.

Как показал опыт обучения моделей GPT-4o и GPT-3.5, даже на простых примерах достоверность результатов не была соблюдена в 5,6% случаев, «человеческий фактор» был признан виновным среди них только в 2,8% случаев.

Рисунок 2. Оценка достоверности ответов, получаемых в различных LLM

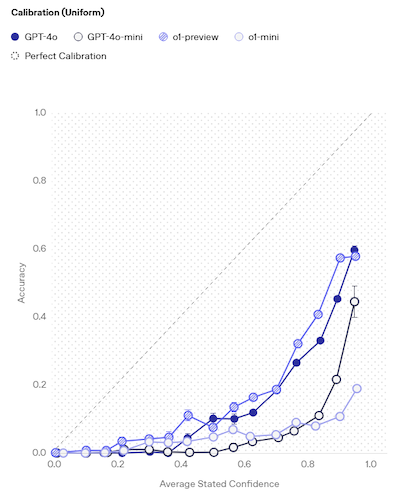

Из этого можно сделать вывод, что развитие LLM нацелено на создание методик для калибровки LLM. Они позволят переопределять ранее назначенные весовые коэффициенты. Их замена будет нацелена на повышение уровня достоверности конечных результатов.

Уже появились первые сравнительные диаграммы для различных LLM, где можно оценить влияние калибровки. Например, по данным, которые приводит OpenAI, модели o1‑preview и GPT-4o откалиброваны лучше, чем o1‑mini и GPT-4o-mini соответственно.

Рисунок 3. Оценки уровня калибровки для различных LLM

Почему LLM ошибаются: ключевые причины снижения точности GenAI

В своем интервью Кевин Ву (Kevin Wu), основатель и директор компании Pegasi AI, отметил, что недетерминированное поведение LLM не является ошибкой. «Это — фундаментальная особенность, вытекающая из того, как построены эти системы. Доказательства очевидны: с момента выпуска GPT-4 в марте 2023 года каждая новая модель OpenAI показывала более высокие показатели «галлюцинаций» в своих ответах на текстовые вопросы. В бенчмарке SimpleQA от OpenAI были испытаны новые модели, такие как o3-mini. Они сумели достичь только 13,4% точности в ответах даже на самые простые вопросы».

Ву считает, что снижение надежности утверждений LLM по мере наращивания размеров их базы обусловлены рядом ключевых факторов:

- «Статистический» характер ответов. На самом деле современные системы на базе ИИ не понимают языка или фактов. Не понимают они также и сущности поставленной перед ними прикладной задачи. Вместо этого они выполняют сложные вероятностные вычисления на основе шаблонов, запомненных при обучении. Вообразим себе Шерлока Холмса, который бы запомнил подробности тысячи преступлений, но никогда сам не расследовал ни одного.

- Ограничения обучающих массивов данных. Обучающие данные, насколько бы обширными они ни были, не могут охватить всего многообразия, характерное для жизни и то, как воспринимает задачу человек. Более того, часто оказывается, что массивы данных содержат противоречия и предубеждения, которые в дальнейшем отражаются в ответах LLM.

- Архитектурные ограничения. Проблема состоит в том, что в реальности при подготовке ответа LLM могут «видеть» одновременно только очень ограниченное по своему охвату «окно контекста». При этом каждый генерируемый токен становится контекстом для следующего, вызывая эффект снежного кома, что приводит к усугублению ошибок. При этом в LLM отсутствуют механизмы для фактчекинга на предмет соответствия реальной действительности.

Как же достичь достоверности и преодолеть названные ограничения?

Будущее GenAI: какие шаги нужны для повышения надежности

Пора внести ясность, что же изменилось за два года после публикации письма The Future of Life Institute. Можно ли поручать ИИ принятие ответственных решений сегодня?

Вряд ли кто-то из подписавших два года назад письмо The Future of Life Institute ждал, что за шесть месяцев произойдут «революционные» изменения в оценке применимости LLM.

Если прочитать письмо более внимательно, то можно найти, что в нем предлагалось «использовать паузу для совместной разработки и внедрения набора общих протоколов безопасности для проектирования и разработки передового ИИ, которые будут строго проверяться и контролироваться независимыми внешними экспертами. <…> Исследования и разработки ИИ должны быть переориентированы, чтобы сделать уже созданные мощные сверхсовременные системы более точными, безопасными, интерпретируемыми, прозрачными, надежными, согласованными, заслуживающими доверия и невраждебными».

Рисунок 4. Часть письма The Future of Life Institute с задачами на этап паузы

Разработка новых методик калибровки LLM выглядит вполне логичным шагом в развитии GenAI.

Как обеспечить достоверность и безопасность при работе с LLM

Развитие систем генеративного ИИ продолжается. Пока рано говорить, как будут выстроены гарантии, подтверждающие достоверность результатов их работы.

Но как тогда компании, внедряющие GenAI в свой технологический процесс, смогут гарантировать, что предоставляемые им ИИ-ответы являются точными и содержательными? Как они смогут получить гарантии конфиденциальности данных, безопасности их передачи, управления рисками?

Кевин Ву считает, что достоверность ответов ИИ будет достигнута за счет применения следующих передовых практик:

- Применение надежных исходных данных, прошедших предварительную тонкую обработку. Для этого должны применяться управляемые конвейеры данных и специальная настройка модели на основе специфичной информации. Это позволит LLM усваивать релевантный контекст.

- Использование правил и ограничений. Ответы ИИ должны согласовываться с основными бизнес-целями компании-эксплуатанта. Это будет достигаться за счет индивидуализированного промпт-инжиниринга и соблюдения этических правил.

- Применение систем автокоррекции. Разумно полагаться на преимущества комплексных ИИ-систем, способных пересматривать и автоматически корректировать выводы, а также фильтровать нежелательные ответы.

- Постоянная верификация и мониторинг. Потребуется реализовать итеративное тестирование, фактчекинг в режиме реального времени и аудит, чтобы непрерывно обеспечивать точность собранных данных и их соответствие требованиям.

- Управление конфиденциальностью и рисками. Собранные данные придется защищать с помощью шифрования, соблюдать нормативные стандарты для их обработки, проводить регулярную оценку и аудит рисков.

По мнению Кевина Ву, такой многоуровневый подход поможет принимать разумные решения, одновременно защищая конфиденциальную информацию и управляя рисками.

Выводы

Создание систем, способных принимать ответственные управленческие решения на базе ИИ, идёт полным ходом. Приведенный в начале пример использования ИИ для нужд МО США показывает, что такие системы уже добрались до оборонных сфер, где цена ошибки чрезвычайно высока. Известны и примеры внедрений в области здравоохранения: ещё 10 лет назад IBM Watson помогал принимать врачебные решения по онкологическим заболеваниям.

Применение LLM для принятия ответственных решений не только затрагивает этические вопросы, меняет принципы доверия и принимаемые гарантии, но и способствует дальнейшему развитию самих основ создания ИИ-моделей. Дело не ограничивается модификацией алгоритмов управления данными: оно касается и смежных областей, в том числе требований по безопасности и регуляторному надзору. Этим изменениям следует уделять сейчас повышенное внимание.