В прошлом месяце ИИ-бот ChatGPT обрел новый генератор изображений с выпуском модели 4o. Первые пробы показали, что создаваемые с его помощью картинки с вставленным текстом стали более реалистичными.

Пользователи ChatGPT теперь заставляют его генерировать ресторанные счета и получают вполне убедительные дипфейки.

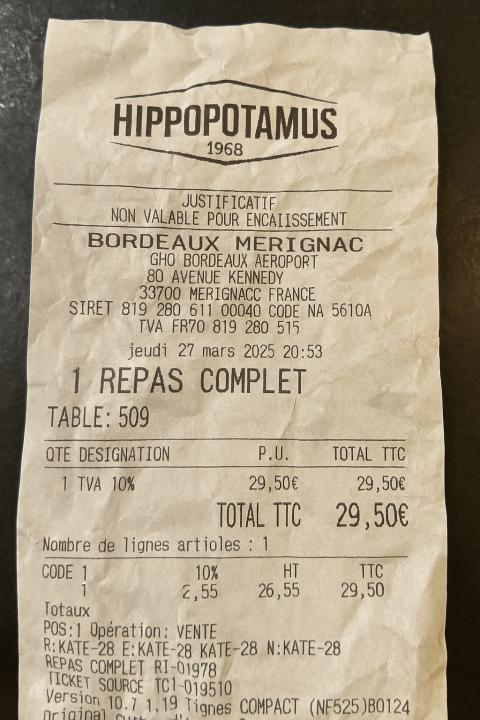

Фото одной из таких фальшивок было опубликовано в X.

Другие юзеры подхватили идею, добились схожих результатов, а в одном из случаев тот же фейковый счет был для большего правдоподобия «испачкан»:

Наиболее реалистичный образец получился у французского специалиста в области ИИ — из-за эффекта помятой бумаги.

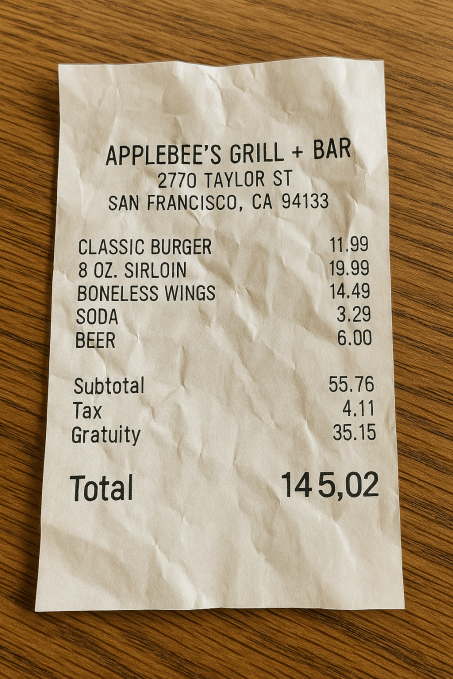

В TechCrunch тоже опробовали новинку и получили вполне сносный вариант для гриль-бара в Сан-Франциско. Правда, в итоговой сумме вместо точки стояла запятая, к тому же у ChatGPT, видимо, плохо с арифметикой, но эти огрехи при желании можно быстро исправить, конкретизировав подсказки, или с помощью графического редактора.

В комментарии для онлайн-издания представитель OpenAI заявила, что все изображения, генерируемые ИИ-ботом, снабжены соответствующими метаданными. Обнаружив нарушение пользовательского соглашения, компания «принимает меры» и «учится» на таких случаях.

В ответ на вопрос, зачем вообще позволять ChatGPT соглашаться на авантюры, попахивающие злоупотреблением, собеседница подчеркнула, что их цель — предоставить юзерам «как можно больше свободы творчества». К тому же фейковые счета необязательно нужны для мошенничества, их можно использовать в целях финансового ликбеза, а также для создания оригинальных картин или продуктовой рекламы.