В Android-версии мессенджера Telegram выявили уязвимость, позволяющую отправлять вредоносные APK-пейлоады, маскируя их под видеоконтент. Брешь получила имя «EvilVideo».

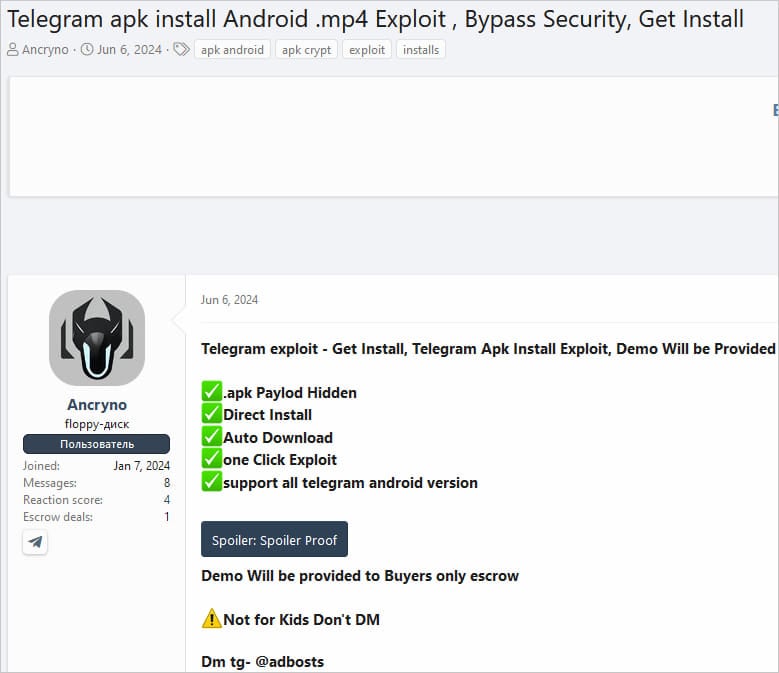

Некий киберпреступник под ником Ancryno 6 июня 2024 года опубликовал на хакерском форуме XSS объявление о продаже эксплойта нулевого дня для Telegram.

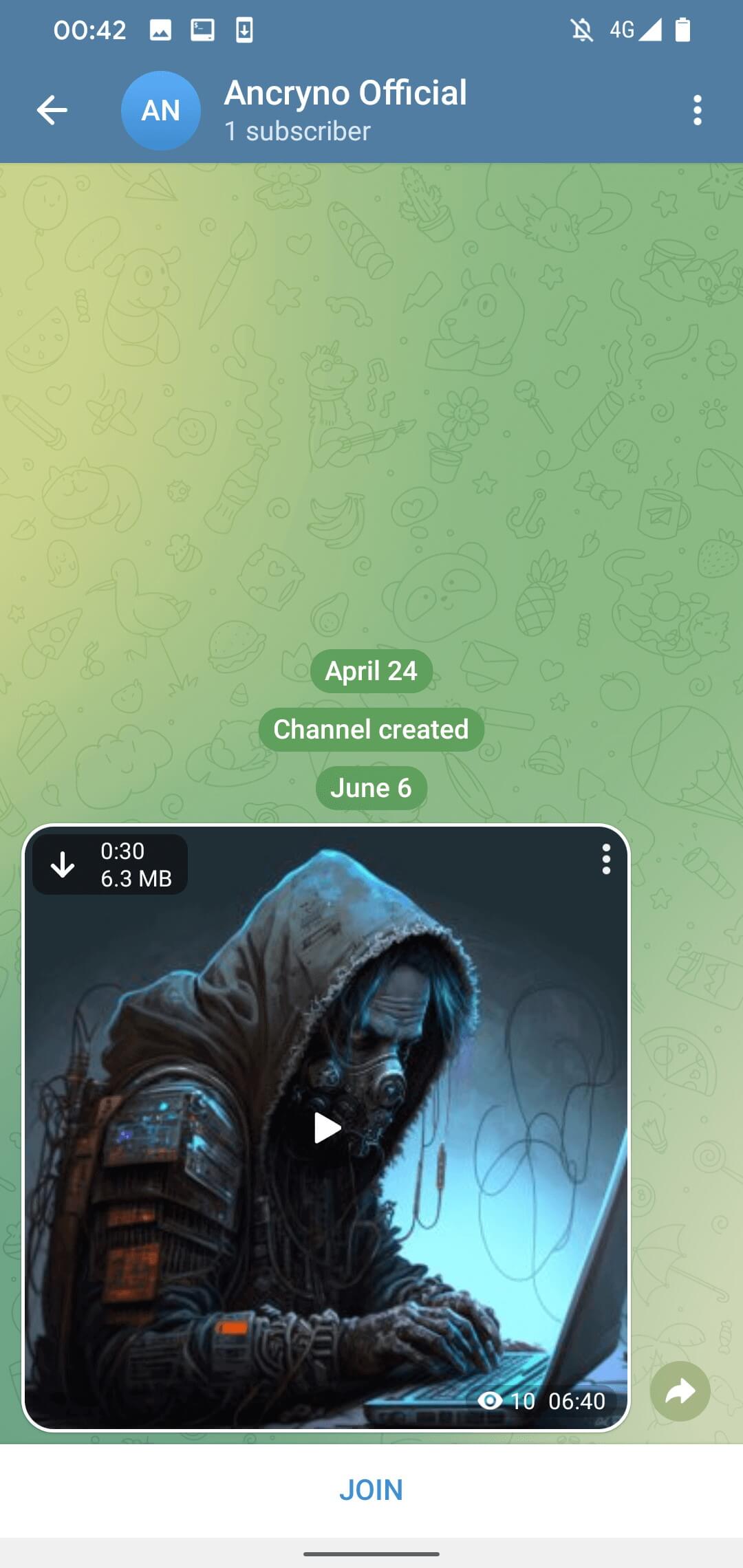

Тогда утверждалось, что уязвимость актуальна для Telegram v10.14 и более древних версий мессенджера. Исследователи из антивирусной компании ESET обнаружили демонстрационный эксплойт (PoC) в одном из открытых телеграм-каналов.

Именно в ESET проблему назвали EvilVideo, параллельно подтвердив, что PoC работал для v10.14.4 и более старых релизов Telegram. 4 июля разработчики мессенджера отреагировали, заявив, что брешь была закрыта с выходом 10.14.5 (вышла 11 июля).

На деле это значит, что у злоумышленников были как минимум пять дней на эксплуатацию EvilVideo. Специалисты пока затрудняются сказать, использовалась ли уязвимость в реальных кибератаках, однако они наткнулись на командный сервер infinityhackscharan.ddns[.]net, на котором хранились пейлоады.

В ESET считают, что корень бреши кроется в API Telegram, позволяющем на программном уровне создавать сообщения в виде 30-секундных видео.

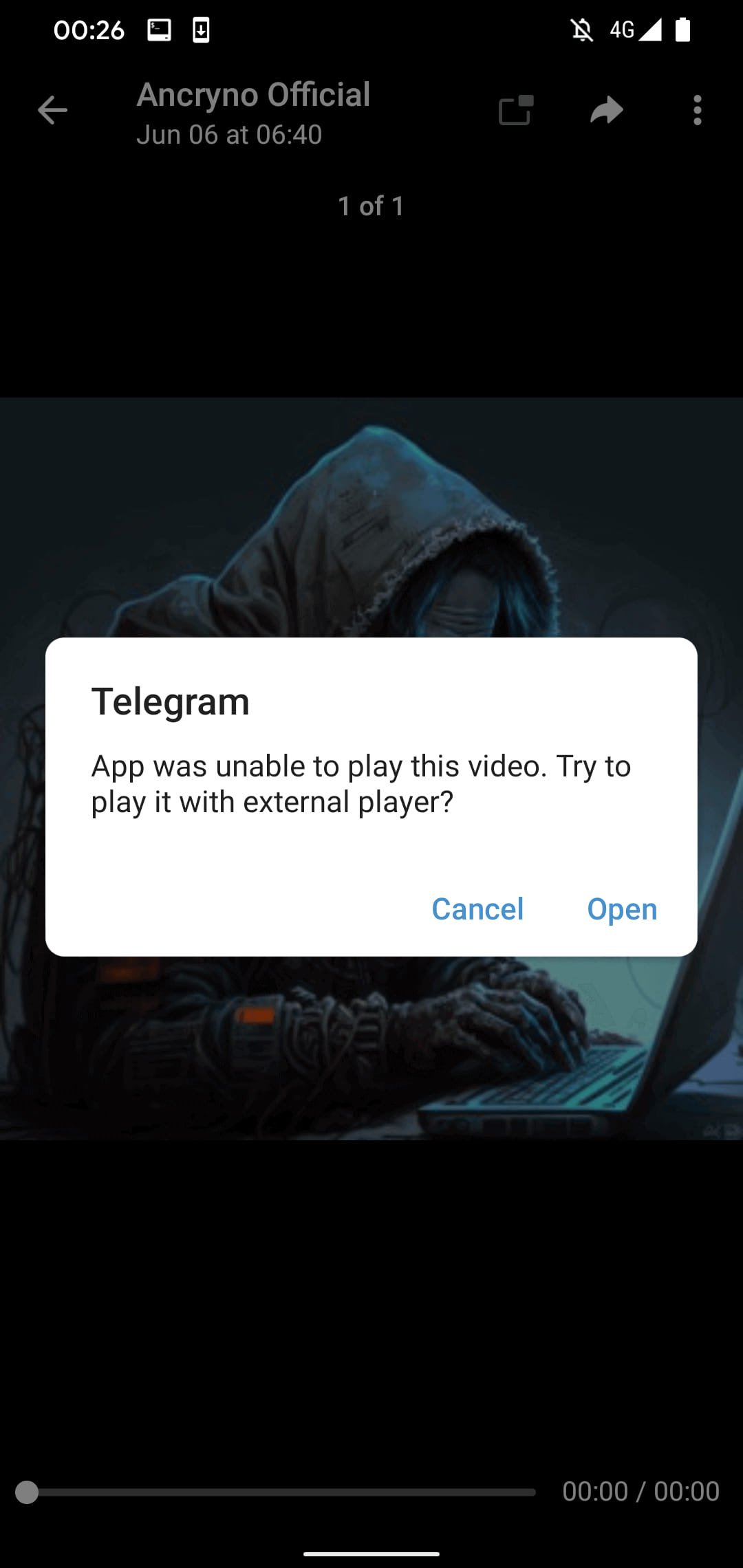

Настройки Telegram по умолчанию подразумевают автоматическую загрузку медиафайлов. При попытке просмотреть видео, под которое замаскирован вредонос, пользователю предложат скачать сторонний плеер, что и приведет к загрузке APK.

ESET выложила на YouTube ролик, в котором демонстрируется эксплуатация уязвимости: