Основанная на ИИ система Apple Intelligence, которую купертиновцы готовятся представить осенью вместе с iOS 18, iPadOS 18 и macOS Sequoia, имеет существенный изъян по части информационной безопасности: разработчики не научили её отличать фишинговые письма от обычных.

Как известно, Apple Intelligence учитывает личный контекст, упрощая работу с Safari и таким «родным» софтом, как «Сообщения», «Почта», «Заметки», «Календарь».

Несмотря на заверения Apple об отсутствии угроз для конфиденциальности, ряд пользователей на площадке Reddit указал на неспособность Apple Intelligence отличить опасное электронное письмо.

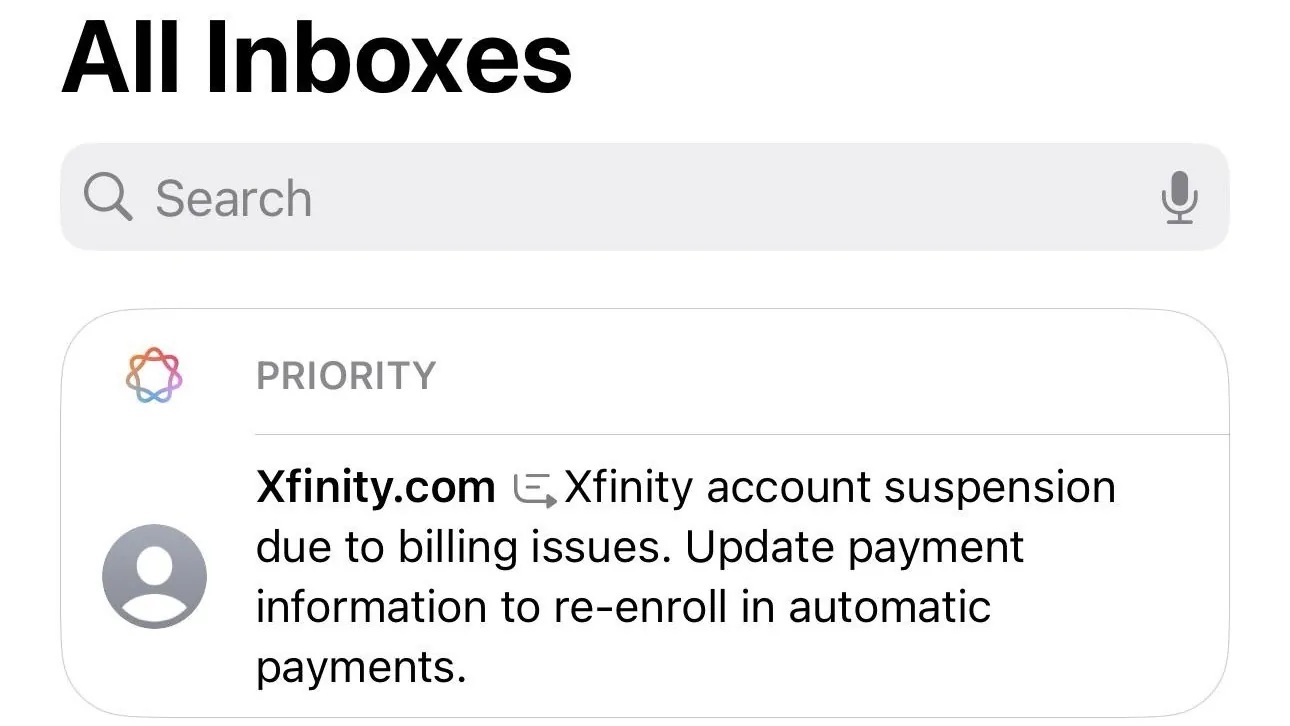

Более того, основанный на ИИ фильтр в приложении «Почта» помечает мошеннические письма флажком «Приоритетные». Другими словами, система оценивает письмо исключительно по тексту, игнорируя, например, отправителя и другие маячки.

«Почту» в iOS и macOS и так давно преследует проблема фишинга, поскольку приложение не может эффективно детектировать подозрительные или опасные письма. Однако Apple Intelligence только усугубляет ситуацию, поскольку маркировка «Приоритетные» повышает шансы на открытие сообщения.

Тем не менее запуск ИИ-системы планируется на осень, поэтому дадим разработчикам время доработать её. Возможно, в день запуска всё будет не так плохо.

Напомним, нюансы Apple Intelligence мы разбирали в статье «ИИ-прорыв или кошмар для конфиденциальности владельцев iPhone?».