Университетские исследователи показали, как удаленно получать пароли и другой ввод с виртуальной клавиатуры Vision Pro. Метод GAZEploit основан на анализе движения глаз аватарки в ходе видеосвязи на гаджете Apple и использует с этой целью ИИ.

Очки смешанной реальности Vision Pro предоставляют возможность управления взглядом (айтрекинга) и при видеозвонках создают 3D-аватар, отображаемый собеседнику. Команда из Университета Флориды и Техасского технологического университета обнаружила, что этот персонаж точно воспроизводит направление глаз юзера, фиксируемое клавиатурой, и в результате может слить вводимые данные.

Атака GAZEploit проводится в два этапа. Вначале определяются расположение и размеры виртуальной клавиатуры (путем геометрических расчетов), а также сам факт ввода текста — по концентрации взгляда, снижению частоты морганий и характерному чередованию саккад (последовательное перемещение глаз по деталям объекта) и фиксаций (пауз).

Для вычисления стабильности айтрекинга был создан алгоритм, а также установлен порог, позволяющий различать саккады и фиксации. Все необходимые данные исследователи собрали с помощью 30 добровольцев, скормили их рекуррентной нейронной сети и в итоге получили точность определения набора на клавиатуре 98%.

На втором этапе GAZEploit проводится анализ. Снятая с аватарки информация сопоставляется с раскладкой виртуальной клавиатуры, и по результатам делаются выводы.

По словам исследователей, им удалось добиться точности определения «нажатых» клавиш 85,9% (precision, доля правильно классифицированных объектов среди всех объектов, которые к этому классу отнес классификатор, в том числе неверно) и полноты 96,8% (отношение верно классифицированных объектов класса к общему числу элементов этого класса, с учетом ложноотрицательных срабатываний).

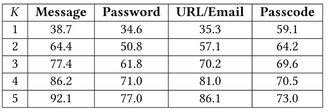

Таким же образом можно перехватить не только пароль, но и ПИН-код, сообщение, адрес имейл. «Угадайка» в лабораторных условиях (до пяти попыток) показала следующие результаты:

О найденной уязвимости минувшей весной было доложено разработчику гаджета, и в конце июля Apple выпустила патч для CVE-2024-40865 в составе сборки VisionOS 1.3.

Предыдущее обновление этой ОС (июньское 1.2) содержало заплатку для другой дыры, объявившейся в Vision Pro, — CVE-2024-27812. Недочет позволял обойти защиту виртуального пространства пользователя и вбросить в него анимированные и озвученные «страшилки» — змей, пауков, летучих мышей.