Эксперты Trustwave SpiderLabs предупреждают о новой уловке фишеров: на одном из сайтов-ловушек обнаружен чат-бот, который шаг за шагом выманивает у посетителей целевую информацию. Использование интерактивного элемента придает больше убедительности фальшивке; с той же целью злоумышленники имитируют CAPTCHA и прием платежей с двухфакторной аутентификацией (2FA).

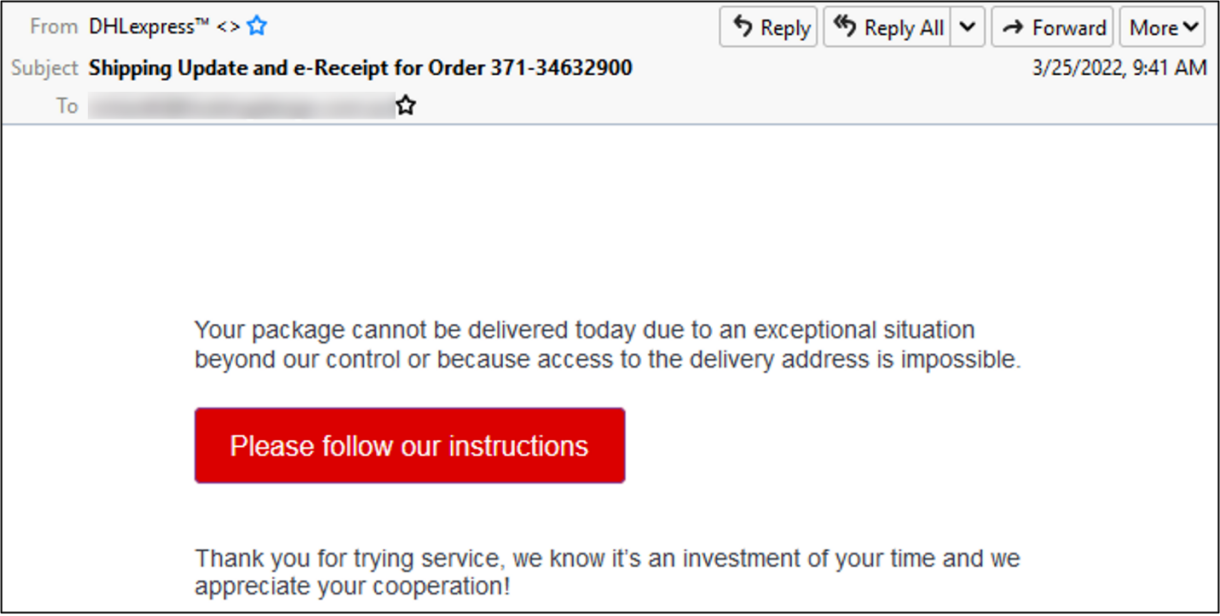

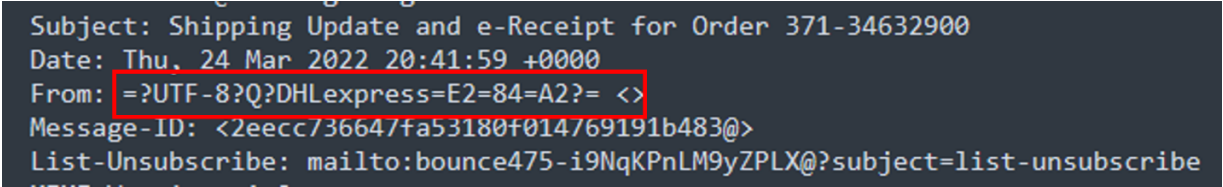

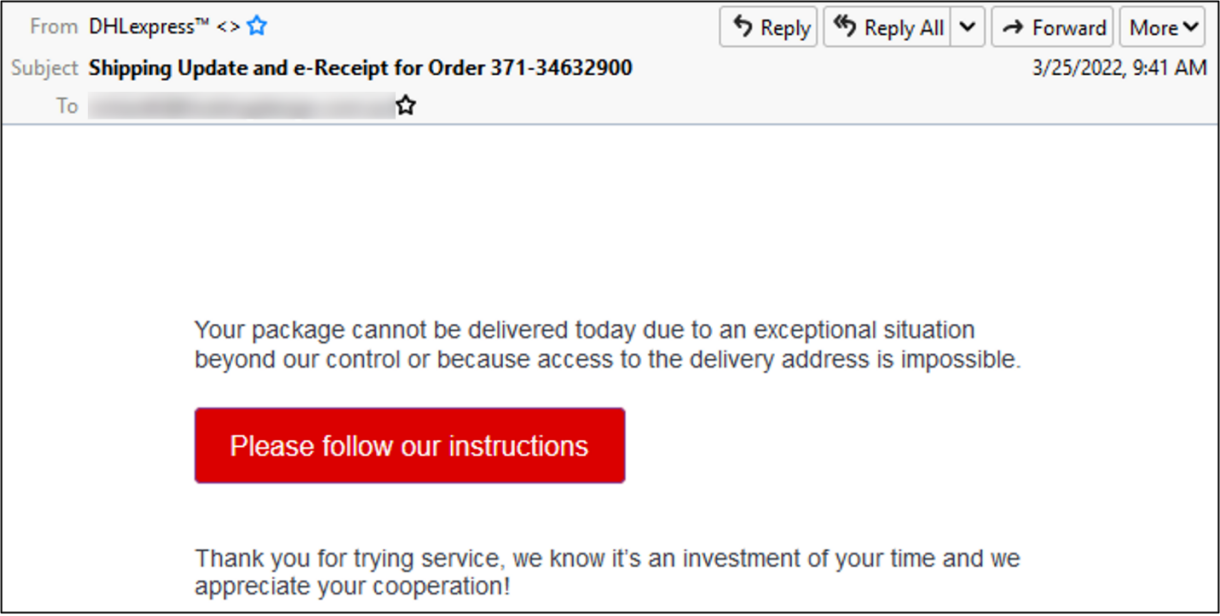

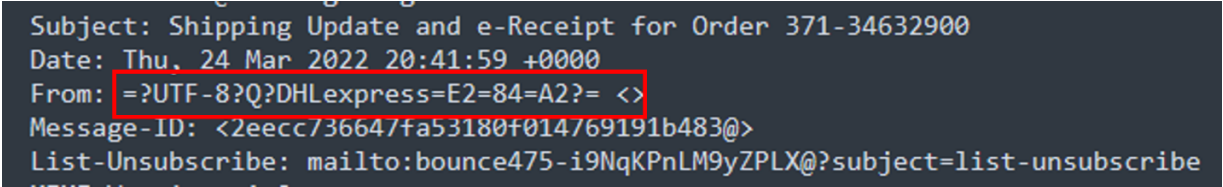

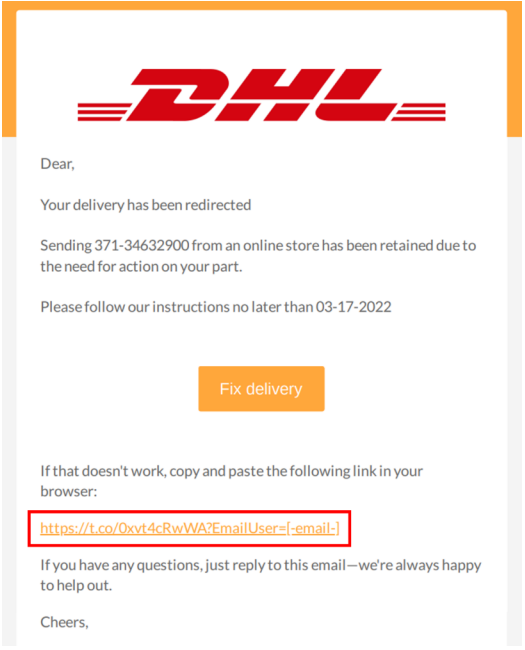

Атака, как обычно, начинается с фишингового письма — в данном случае с извещения DHL о проблемах с доставкой. Анализ email-заголовков показал, что в строке From: отсутствует адрес отправителя.

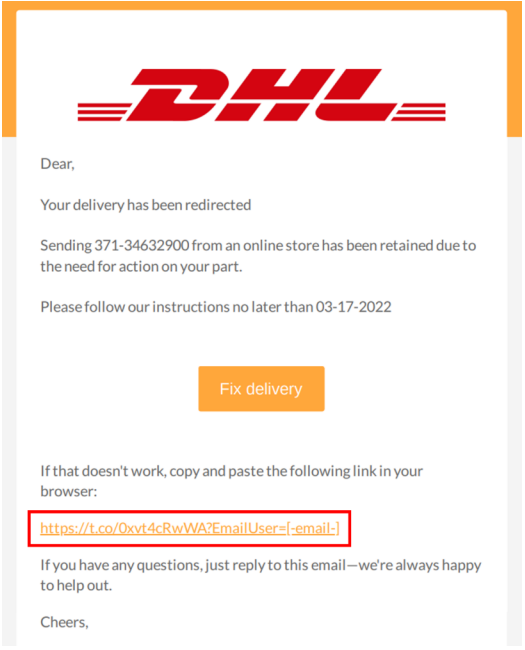

Нажатие кнопки, вставленной в тело письма, инициирует запуск браузера и загрузку PDF-файла со ссылками на фишинговый сайт. Этот трюк призван ввести в заблуждение email-защиту.

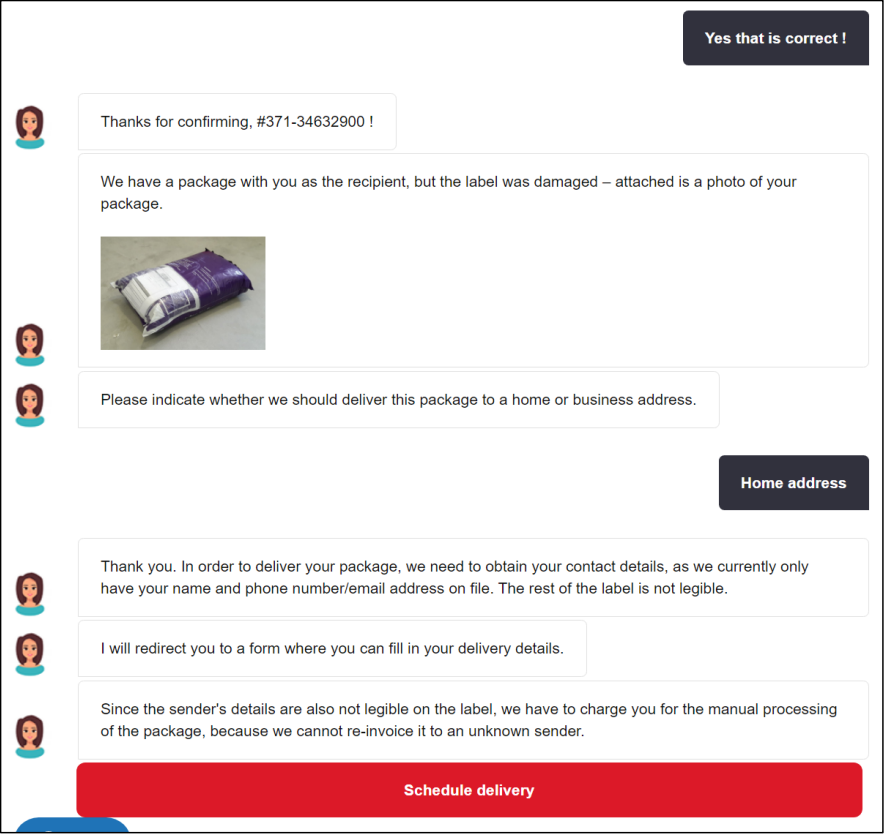

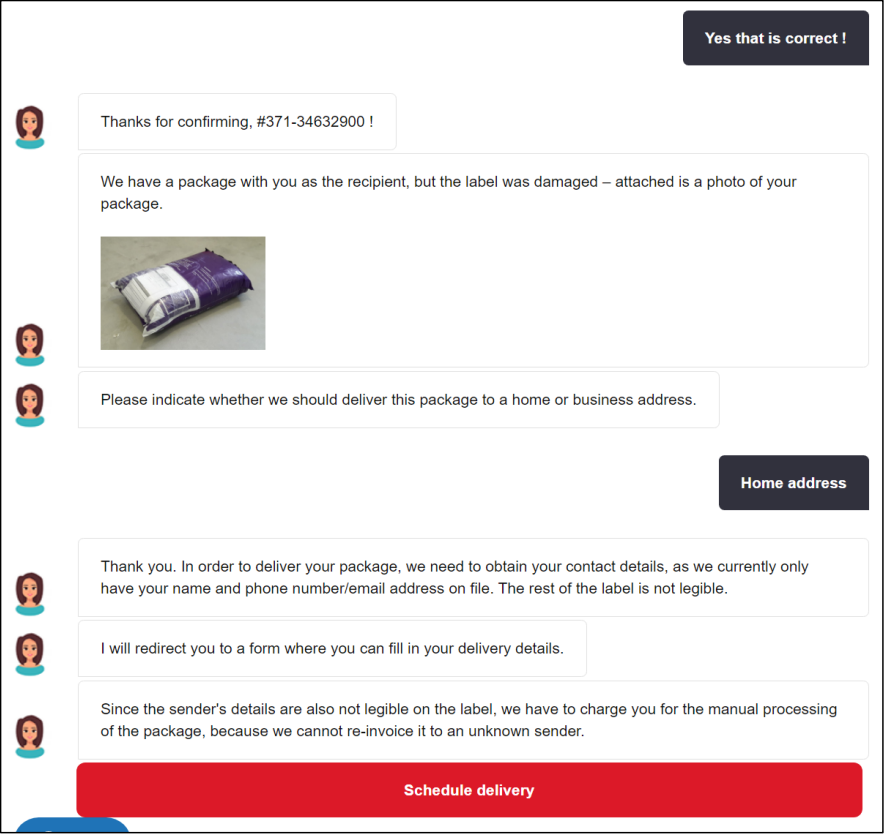

На сайте-ловушке посетителя приветствует виртуальный помощник. Это подобие чат-бота обладает скромным набором реплик, его основная задача — завоевать доверие потенциальной жертвы и заставить ее заполнить фишинговые формы.

Визитера просят подтвердить номер для отслеживания почтового отправления и поясняют, что в ходе транспортировки стикер на бандероли был поврежден, в результате доставка стала невозможной. Для достоверности чат-бот показывает фото некой бандероли, предлагая предоставить недостающие данные и оплатить повторное оформление мелкого пакета, которое придется выполнить вручную.

Если адресат согласен на изменение сроков доставки и кликнет по предложенной кнопке, ему покажут CAPTCHA — картинку, встроенную в HTML. Уловка тоже призвана создать иллюзию легитимности ресурса, но в отличие от чат-бота уже использовалась в атаках фишеров.

Затем пользователя просят заполнить первую фишинговую форму — ввести учетные данные DHL (email и пароль) и предпочтительный адрес доставки. После отправки этих сведений его перенаправляют на страницу Secure Pay, где требуется ввести данные платежной карты: имя владельца, номер, срок действия и код CVV.

Аналитики заметили, что Secure Pay при этом проверяет правильность номера карты и пытается определить ее тип. По завершении процесса жертве через редирект отображается страница подтверждения транзакции с полем для ввода одноразового пароля, якобы высланного в виде СМС.

Примечательно, что номер телефона при этом не запрашивали, в формах фишеров эта строка отсутствует. Исследователи попробовали вводить произвольные цифры, но им каждый раз сообщали, что время ввода истекло, и возвращали на ту же страницу. Пятая попытка оказалась успешной — «код» с благодарностью приняли.

Приведенный здесь образец фишингового письма был обнаружен 25 марта. Сайт с чат-ботом все еще работает, но перенесен в другой домен — какой, эксперты не пишут. Прежний, 24mhd[.]com, явно не имел ничего общего с используемым брендом; в URL страниц, правда, имя DHL было вставлено, но с опечаткой в расчете на невнимательность пользователей— как dhi (см. список фишинговых ссылок в блог-записи SpiderLabs).