Специалисты F.A.C.C.T. выявили кампанию, нацеленную на кражу данных у бизнесменов с помощью инфостилеров. Ее инициаторы используют адресные рассылки и проводят атаки в разных регионах, в том числе в России.

На настоящий момент обнаружено более 500 вредоносных писем, адресованных российским компаниям. Как оказалось, кибергруппа, условно нареченная Narketing163 (по имени одного из используемых аккаунтов отправителя), активна в рунете как минимум с середины 2023 года.

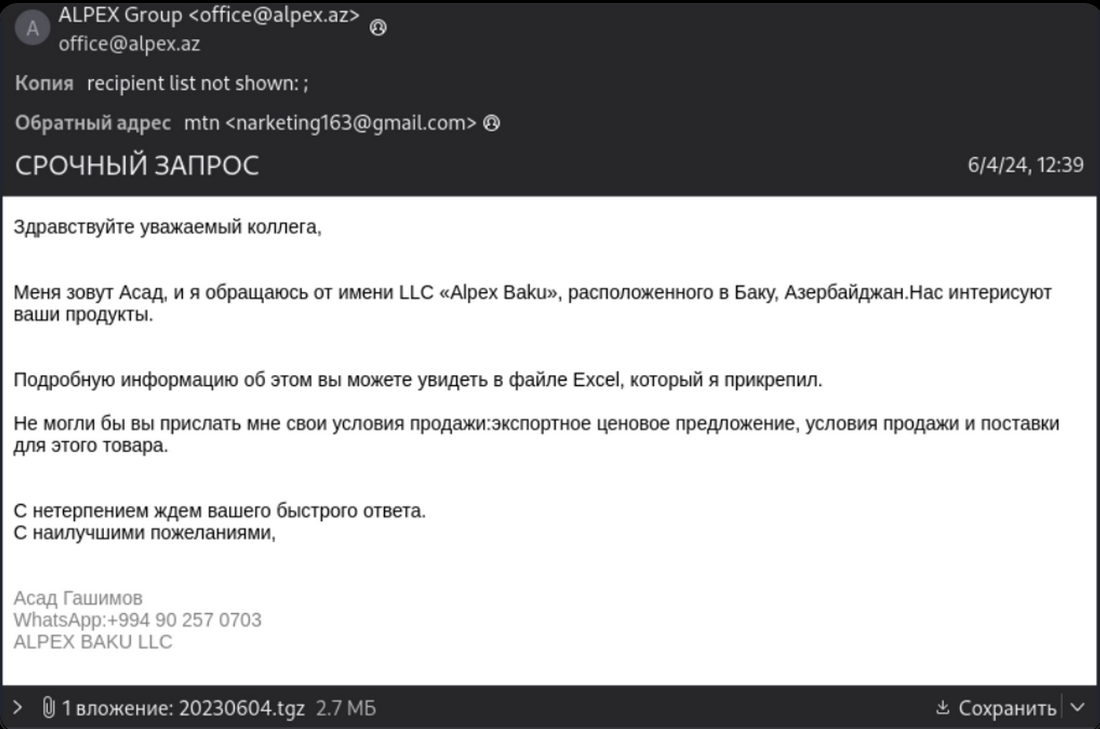

Сообщения, имитирующие деловую переписку, получают ретейлеры, химики, медики, строители, страховщики. Они рассылаются из TLD-доменов TR, AZ, KZ, PE, INFO, NET, COM; не исключено, что соответствующие ящики взломаны — либо злоумышленники используют спуфинг (подмену адреса отправителя).

Четыре аккаунта, по мнению аналитиков, были специально созданы для проведения рассылок:

- narketing163[at]gmail[.]com

- tender12[at]mail[.]com

- verconas[at]mail[.]com

- kubrayesti[at]gmail[.]com

Серверы, с которых отправляются вредоносные письма (IP-адреса), часто меняются. Фальшивки оформлены на русском, азербайджанском, турецком, английском языках; у получателя могут запросить расценки на товары / услуги, сроки поставок, способы оплаты.

Вложенный архив содержит исполняемый файл — заточенного под Windows зловреда. В письмах Narketing163 обнаружены четыре варианта полезной нагрузки: RedLine Stealer, Agent Tesla, FormBook и кейлоггер Snake. Для вывода краденых данных используются серверы, поднятые на Сейшелах и в Нидерландах.